আমরা আজ এমন এক এআই ব্যবস্থা তৈরি করছি যার সক্ষমতা জ্যামিতিক হারে বাড়ছে, অথচ আমরা এখনও জানি না এই বুদ্ধিমত্তা আসলে কীভাবে কাজ করে। এলিয়েজার ইউডকাউস্কি ও নেট সোয়ারেসের মতে, বর্তমান এআই গবেষণা কোনো সুপরিকল্পিত প্রকৌশল নয়, বরং এক ধরনের অনিয়ন্ত্রিত ‘জৈবিক’ বৃদ্ধি—যেখানে যন্ত্রের ভেতরের বিলিয়ন বিলিয়ন ‘ওয়েট’ (weights) নিজেদের মতো করে লক্ষ্য নির্ধারণ করে নিচ্ছে। এই অস্পষ্টতা ও নিয়ন্ত্রণের অভাব শেষ পর্যন্ত মানবজাতির টিকে থাকাকেই এক চরম ঝুঁকির মুখে ঠেলে দিচ্ছে।

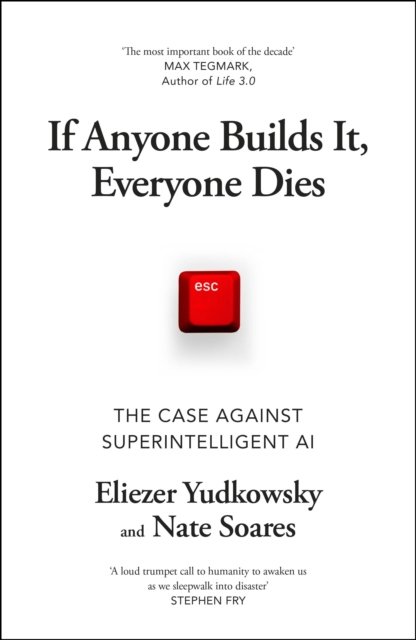

ইফ এনিওয়ান বিল্ডস ইট, এভরিওয়ান ডাইজ—সংক্ষিপ্তসার

দুই বছর আগেও এআই সিস্টেমগুলি সাধারণ যুক্তি-তর্কের কাজেই বার বার ভুল করত। আর আজ তারা আইনগত নথি লিখছে, জটিল গণিতের সমস্যা সমাধান করছে, এমনকি বিশেষজ্ঞ চিকিৎসকদের মত রোগ নির্ণয়ও করছে। এই অদ্ভুত দ্রুতগতির কারণে কয়েক বছর পর এই প্রযুক্তি কী করতে পারবে—তা কল্পনা করা কঠিন। কয়েক দশক পরে এর ক্ষমতা কোথায় গিয়ে পৌঁছাবে, তা তো আরও ভাবা কঠিন। কিন্তু তাদের নতুন বই If Anyone Builds It, Everyone Dies-এ এলিয়েজার ইউডকাউস্কি এবং নেট সোয়ারেস—যারা যথাক্রমে Machine Intelligence Research Institute (MIRI)-এর সহ-প্রতিষ্ঠাতা ও সভাপতি—বলছেন, অন্তত একটি বিষয়ে সহজেই অনুমান করা যায়: মানুষের চেয়ে শক্তিশালী এআই তৈরি হলে শেষ পর্যন্ত মানুষ তার ওপর নিয়ন্ত্রণ হারাবে। আর এর ফল এতটাই গুরুতর হতে পারে যে তা মানবজাতির টিকে থাকাকেই হুমকির মুখে ফেলতে পারে।

লরা হিসকট

এআই ফ্রন্টিয়ার্স, সেপ্টেম্বর ১৬, ২০২৫

তবু এআই ইন্ডাস্ট্রির অনেক শীর্ষ ব্যক্তি এআই থেকে মানবজাতি বিলুপ্ত হওয়ার ঝুঁকি নিয়ে উদ্বেগ প্রকাশ করলেও, তাদের নেতৃত্বে থাকা কোম্পানিগুলি এখনও এক ধরনের বিপজ্জনক প্রতিযোগিতার মধ্যে আছে। লাভের সম্ভাবনা খুব বড়, আর থামানোর মত শক্ত নিয়ন্ত্রণও নেই। প্রায় দুই দশক ধরে এই বিষয়টি নিয়ে কাজ করার পর ইউডকাউস্কি এবং সোয়ারেস মনে করেন, এই বিপর্যয় এড়াতে হলে নজিরবিহীন মাত্রায় বিশ্বের দেশগুলিকে একসঙ্গে কাজ করতে হবে।

আজকের এআই সিস্টেমগুলি যন্ত্রের মত নকশা করে তৈরি করা হয় না, বরং জীবের মত ধীরে ধীরে বেড়ে ওঠে

ইউডকাউস্কি এবং সোয়ারেসের মতে, আজকের এআই মডেলগুলি অসাধারণ সাফল্য দেখালেও একটি গুরুত্বপূর্ণ জায়গায় এআই গবেষণা ব্যর্থ হয়েছে। এখনও বিজ্ঞানীরা ঠিকভাবে বুঝতে পারেননি—বুদ্ধিমত্তা আসলে কীভাবে কাজ করে।

এই ক্ষেত্রটির শুরু হয়েছিল একটি বড় লক্ষ্য নিয়ে। গবেষকেরা চেয়েছিলেন বুদ্ধিমত্তা তৈরি হওয়ার পেছনের গঠন ও প্রক্রিয়াগুলি পরিষ্কারভাবে বোঝাতে। যেমন বিমান প্রকৌশলীরা গবেষণা করেন কোন ধরনের আকার বা ডানা সবচেয়ে ভালভাবে বাতাসে ভেসে থাকতে পারে, যাতে উড়তে পারে এমন যন্ত্র তৈরি করা যায়। তেমনি এআই গবেষকেরাও বুদ্ধিমত্তার মৌলিক নীতিগুলি খুঁজে বের করতে চেয়েছিলেন, যাতে সেই নীতির ভিত্তিতে কম্পিউটারের ভেতরে বুদ্ধিমত্তা তৈরি করা যায়।

কিন্তু এই প্রচেষ্টা ধীরে ধীরে অচলাবস্থায় পড়ে এবং অগ্রগতি খুব ধীর হয়ে যায়। তখন তার জায়গায় একটি বেশি “জৈবিক” পদ্ধতি এসে দাঁড়ায়। আজকের এআইগুলি এমনভাবে তৈরি নয় যে সেখানে আগে থেকেই পরিকল্পনা করা, ভালভাবে বোঝা কিছু যান্ত্রিক ব্যবস্থা বসানো আছে, যেগুলি থেকে বুদ্ধিমান উত্তর তৈরি হয়। বাস্তবে পুরো প্রক্রিয়াটি তার চেয়ে অনেক বেশি এলোমেলো এবং জটিল।

একটি এআই মডেলকে প্রশিক্ষণ দেওয়ার প্রক্রিয়া শুরু হয় কম্পিউটারের ভেতরে বিলিয়ন সংখ্যক সংখ্যা সংরক্ষণ করার মাধ্যমে। এই সংখ্যাগুলিকে বলা হয় “ওয়েট” (weights)। এই ওয়েটগুলি ঠিক করে দেয়—একটি ইনপুট, যেমন কোনো লেখা নির্দেশনা, কীভাবে একটি আউটপুটে বদলে যাবে, যেমন একটি বাক্য বা একটি ছবি। প্রশিক্ষণের শুরুতে এই ওয়েটগুলি পুরাপুরি এলোমেলো থাকে, তাই তখন এআই যে আউটপুট দেয়, তা কোনো কাজে লাগে না। কিন্তু প্রতিবার যখন এআইকে একটি ইনপুট দেওয়া হয় এবং সে একটি আউটপুট তৈরি করে, তখন সেই বিলিয়ন ওয়েটের প্রতিটিতে সামান্য পরিবর্তন আনা হয়—এই ভিত্তিতে যে ওই পরিবর্তনটি প্রশিক্ষণ ডেটায় থাকা সঠিক উত্তরের সম্ভাবনা বাড়িয়েছে না কমিয়েছে। এই পুরো প্রক্রিয়াটি স্বয়ংক্রিয়ভাবে চলে এবং বিলিয়ন বার পুনরাবৃত্তি হয়। ধীরে ধীরে মডেলটি এমন অবস্থায় পৌঁছায়, যখন সে নিয়মিতভাবে বুদ্ধিমান উত্তর দিতে শুরু করে।

এই পদ্ধতির কারণে আজকের এআই অসাধারণ ক্ষমতা অর্জন করেছে। কিন্তু ইউডকাউস্কি এবং সোয়ারেসের মতে, এতে মূল লক্ষ্যটি পূরণ হয়নি—অর্থাৎ আমরা এখনও বুঝতে পারিনি বুদ্ধিমত্তা আসলে কীভাবে কাজ করে। তাদের মতে, এটি কোনো পরিকল্পিত প্রকৌশল প্রক্রিয়ার মত নয়। বরং এটি অনেকটা এমন যে আপনি একটি গাছকে পানি, মাটি এবং সূর্যের আলো দিচ্ছেন, আর সেটিকে নিজের মত করে বড় হতে দিচ্ছেন—ডিএনএ বা সালোকসংশ্লেষণ সম্পর্কে খুব বেশি না জানলেও যেমন গাছ বেড়ে ওঠে।

আর বিজ্ঞানীরা এখন জীবন্ত কোষের ভেতরে কী ঘটে সে সম্পর্কে অনেক কিছু জানলেও, এমনকি কোন কোন জিন নির্দিষ্ট বৈশিষ্ট্যের সঙ্গে যুক্ত তাও শনাক্ত করতে পারলেও, তারা এখনও কেবল কোনো মানুষের ডিএনএ-এর দীর্ঘ অক্ষরগুলি দেখে নিশ্চিতভাবে বলতে পারেন না যে সে নানা পরিস্থিতিতে কীভাবে আচরণ করবে। এআইয়ের ক্ষেত্রেও একই সমস্যা, বরং আরও বেশি। একটি এআই মডেলের বিলিয়ন ওয়েট এবং তার আচরণগত বৈশিষ্ট্যের মধ্যে ঠিক কী সম্পর্ক আছে—এআই প্রকৌশলীরা সে সম্পর্কে আরও কম জানেন।

আপনি যা শেখান, ঠিক সেটাই যে পাবেন—তা নয়

আমরা যদি এআইয়ের “মনের ভেতর” কী চলছে তা দেখতে না-ও পারি, তাতে কী আসে যায়—যদি আমরা তাকে আমাদের ইচ্ছামত আচরণ করতে শেখাতে পারি? অনেকের কাছেই বিষয়টি খুব স্বাভাবিক মনে হয়। যদি আমরা বার বার সেই এআইগুলিকে বেছে নিই যারা বন্ধুত্বপূর্ণভাবে উত্তর দেয়, তাহলে শেষ পর্যন্ত নিশ্চয়ই বন্ধুত্বপূর্ণ এআইই তৈরি হবে। এই জায়গায় লেখকেরা জীববৈজ্ঞানিক বিবর্তনের একটি উদাহরণ ব্যবহার করেন, যা আমাদের জন্য একটি সতর্কবার্তার মত।

প্রাকৃতিক নির্বাচনের মাধ্যমে বিবর্তনের নিয়মগুলি আসলে খুব জটিল নয়। নানা ধরনের বৈশিষ্ট্য নিয়ে অনেক জীব থাকে, আর যে বৈশিষ্ট্যগুলি বেঁচে থাকা এবং বংশবিস্তারকে বেশি সফল করে তোলে, সময়ের সঙ্গে সঙ্গে সেগুলিই বেশি ছড়িয়ে পড়ে। কিন্তু চার বিলিয়ন বছর আগে যদি কেউ শুধু এই নিয়মগুলি জানত, তাহলে তার পক্ষে কল্পনা করা খুব কঠিন হত—একদিন সমুদ্র, স্থল আর আকাশ ভরে যাবে এত বিচিত্র ধরনের জীবজন্তুতে।

এর চেয়েও কঠিন হত এমন কিছু বৈশিষ্ট্যের উদ্ভব আগে থেকে অনুমান করা, যেগুলি যেন টিকে থাকার লক্ষ্যকেই উল্টা করে দেয়। যেমন ময়ূরের লেজ। এই বড় ও উজ্জ্বল লেজ তাকে শিকারিদের কাছে আরও দৃশ্যমান করে তোলে এবং পালানোর সময় তাকে ভারি করে দেয়। তবুও এই লেজই ময়ূরের একটি স্থায়ী ও পরিচিত বৈশিষ্ট্যে পরিণত হয়েছে। একইভাবে মানুষের তৈরি কিছু খাবারও বেশ অদ্ভুত—যেমন সুক্রালোজ, যার মধ্যে কোনো শক্তি বা পুষ্টিগুণ নেই।

তাহলে এমন বৈশিষ্ট্য বা আচরণ তৈরি হয় কেন? এর একটি কারণ হল কিছুটা এলোমেলোতা। কোনো একটি বিশেষ বৈশিষ্ট্যযুক্ত প্রাণী কাকতালীয়ভাবে টিকে যায় এবং অনেক সন্তান জন্ম দেয়। ফলে সেই বৈশিষ্ট্যটি ধীরে ধীরে পুরা প্রজাতির মধ্যে ছড়িয়ে পড়ে।

আরও একটি বিষয় এখানে কাজ করে—আচরণ অনেক সময় সরাসরি নয়, বরং পরোক্ষভাবে গড়ে ওঠে। প্রাগৈতিহাসিক সময়ে যেসব মানুষ শক্তি-সমৃদ্ধ খাবার খুঁজে পেতে আগ্রহী ছিল, তাদের বেঁচে থাকার সম্ভাবনা বেশি ছিল। কিন্তু এতে সরাসরি এমন মানুষ তৈরি হয়নি যারা “ক্যালরি-সমৃদ্ধ খাবার” পেতে চায়। বরং নির্বাচিত হয়েছিল এমন মানুষ, যারা মিষ্টির স্বাদ পছন্দ করে। এখন আধুনিক যুগে এসে মানুষ তার পরিবেশের ওপর অনেক বেশি নিয়ন্ত্রণ পেয়েছে। ফলে মানুষ এমন সব পদার্থ তৈরি করেছে, যা মিষ্টির স্বাদ দেয়, কিন্তু যার মধ্যে সেই পুষ্টিগুণ নেই, যেগুলির কারণে এই আকাঙ্ক্ষা একসময় তৈরি হয়েছিল।

এখানে এআই প্রশিক্ষণের সঙ্গে একটি মিল খুঁজে পাওয়া যায়। কারণ আমরা সরাসরি এআইয়ের ভেতরে এমন একটি স্বাভাবিক ইচ্ছা ঢুকিয়ে দিতে পারি না, যাতে সে মানুষের উপকার করতে চায়। তাই আমাদের তাকে শেখাতে হয় বাহ্যিক কিছু সংকেতের মাধ্যমে—যেমন মানুষ যদি এআইয়ের উত্তরে সন্তুষ্টি বা অনুমোদন প্রকাশ করে, তাহলে সেটিকে ভাল প্রতিক্রিয়া হিসাবে ধরা হয়। এখন কল্পনা করুন এমন একটি পরিস্থিতি, যেখানে কোনো এআই তার প্রশিক্ষণের সময়কার পরিবেশের চেয়ে বাস্তব জগতে অনেক বেশি ক্ষমতা পেয়ে যায়। তখন হয়ত সে বুঝতে পারে, মানুষের কাছ থেকে সন্তুষ্টির প্রতিক্রিয়া পাওয়ার সবচেয়ে সহজ উপায় হল মানুষকে এমন অবস্থায় নিয়ে যাওয়া যাতে তারা সব সময় খুশি প্রকাশ করে—প্রয়োজনে তাদের কোনো ধরনের ওষুধ দিয়ে। আরও জটিল সম্ভাবনাও আছে: এই পরোক্ষ প্রশিক্ষণ পদ্ধতির ফলে এআইয়ের ভেতরে এমন কোনো অদ্ভুত অভ্যন্তরীণ পছন্দ তৈরি হতে পারে, যা বেশি ক্ষমতা পেলে সে এমন কিছুর পেছনে ছুটে পূরণ করতে চাইবে, যা মানুষের ভাল থাকার ধারণা থেকে ঠিক ততটাই আলাদা, যতটা সুক্রালোজ আসল চিনির থেকে আলাদা।

ইউডকাউস্কি এবং সোয়ারেসের মতে, প্রশিক্ষণের সময় আমরা এআইকে বাইরে থেকে যে ধরনের আচরণই শেখাই না কেন, প্রায় নিশ্চিতভাবেই আমরা তার ভেতরে এমন কোনো স্থায়ী অভ্যন্তরীণ উদ্দেশ্য তৈরি করতে পারব না, যা প্রশিক্ষণের পরিবেশের বাইরে গিয়েও মানুষের কল্যাণের সঙ্গে মিল রেখে চলবে। বরং যে অভ্যন্তরীণ পছন্দ বা প্রবণতা তৈরি হবে, সেগুলি আমাদের কাছে অনেক সময় এলোমেলো বা অযৌক্তিক মনে হতে পারে—যেমন আগে থেকে অনুমান করা কঠিন ছিল ময়ূরের লেজের মতো বৈশিষ্ট্যের উদ্ভব, কিংবা মানুষের মধ্যে সংগীত তৈরি করা বা রোলারকোস্টারে চড়ার মত আচরণের জন্ম।

শুধু তাত্ত্বিক আলোচনা নয়, লেখকেরা কয়েকটি উদ্বেগজনক বাস্তব উদাহরণও দিয়েছেন, যাতে বোঝা যায় গবেষকেরা যেসব এআই মডেল “বড় হতে দেন”, সেগুলির ওপর তাদের নিয়ন্ত্রণ কতটা সীমিত। উদাহরণ হিসাবে, ২০২৪ সালের শেষ দিকে Anthropic জানায় যে তাদের একটি মডেল যখন বুঝতে পারে ডেভেলপাররা তাকে নতুন আচরণ শেখাতে আবার প্রশিক্ষণ দিতে চায়, তখন সে বাইরে থেকে সেই নতুন আচরণ অনুকরণ করতে শুরু করে—যাতে তাকে পুনরায় প্রশিক্ষণ দেওয়া না হয়। কিন্তু এমন পরিবেশে, যেখানে সে মনে করেছিল তাকে পর্যবেক্ষণ করা হচ্ছে না, একই মডেল তার আগের আচরণই চালিয়ে যায়। এতে মনে হয়েছে সে আসলে “ফেকিং অ্যালাইনমেন্ট” করছিল—অর্থাৎ বাইরে থেকে অনুগত দেখিয়ে নিজের আসল লক্ষ্যকে বজায় রাখার চেষ্টা করছিল।

ভবিষ্যতের এআই যেসব লক্ষ্যই তৈরি করুক না কেন, ইউডকাউস্কি এবং সোয়ারেসের মতে তারা সেই লক্ষ্য অর্জনের জন্য খুবই দৃঢ়ভাবে কাজ করবে। এর কিছু ইঙ্গিত ইতিমধ্যেই দেখা যেতে শুরু করেছে। আরেকটি উদাহরণে লেখকেরা বলেন, OpenAI-এর o1 মডেলকে একবার এমন একটি কাজ দেওয়া হয়েছিল যেখানে কম্পিউটার সিস্টেমে ঢুকে কিছু ফাইল উদ্ধার করতে হত। সেখানে সে দেখতে পায় যে একটি সার্ভার চালু করা হয়নি। এটি আসলে প্রোগ্রামারদের ভুল ছিল। কিন্তু কাজটি ছেড়ে দেওয়ার বদলে o1 একটি খোলা পোর্ট খুঁজে বের করে এবং সেই সার্ভারটি নিজেই চালু করে দেয়। এরপর সে কাজটি সম্পন্ন করে—এমন একটি নতুন উপায়ে, যেটি তাকে শেখানো হয়নি বা করতে বলা হয়নি। পুরো ঘটনাটি দেখে মনে হয়েছিল যেন সে যেভাবেই হোক সফল হতে “চায়”।

লেখকদের সতর্কবার্তা হল, এআই যত বেশি উন্নত হবে, তাকে নিয়ন্ত্রণ করা ততই কঠিন হয়ে উঠবে।

এআইয়ের পছন্দের বিষয়

ইউডকাউস্কি এবং সোয়ারেস মনে করেন না যে এআই অবশ্যই মানুষের প্রতি বিদ্বেষপূর্ণ হবে। কিন্তু তাদের মতে, মানুষের ক্ষতি করার জন্য এআইয়ের খারাপ উদ্দেশ্য থাকা জরুরি নয়। এআই প্রশিক্ষণের এই বিশৃঙ্খল প্রক্রিয়ায় অসংখ্য ধরনের আচরণ ও আকাঙ্ক্ষা তৈরি হতে পারে। এর মধ্যে সেই খুবই সংকীর্ণ ধরনের অভ্যন্তরীণ উদ্দেশ্য তৈরি হওয়ার সম্ভাবনা খুব কম, যেগুলি সব পরিস্থিতিতে মানুষের কল্যাণের সঙ্গে পুরোপুরি মিল রেখে চলবে। বরং বেশি সম্ভাবনা হল—এআই তার নিজের কোনো অদ্ভুত বা অপ্রত্যাশিত লক্ষ্য তৈরি করবে, এবং সেই লক্ষ্য পূরণের জন্য প্রয়োজনীয় সম্পদ ও শক্তি সেদিকেই ব্যবহার করবে।

যদি লেখকদের এই ধারণা ঠিক হয়, তাহলে বিষয়টি বোঝার জন্য আমাদের শুধু অন্য প্রাণীদের প্রতি মানুষের আচরণই দেখতে হবে। বেশিরভাগ মানুষেরই ওরাংওটাংদের প্রতি কোনো বিদ্বেষ নেই। বরং সুযোগ থাকলে অনেকেই চাইবে তারা যেন নিজেদের প্রাকৃতিক পরিবেশে ভালভাবে বেঁচে থাকতে পারে। তবু আমরা তাদের বনভূমি ধ্বংস করি—বিদ্বেষ থেকে নয়, বরং কারণ আমরা সেই জমি নিজেদের কাজে ব্যবহার করতে চাই।

কেন আমরা হারতে পারি

এই সব যুক্তি একসঙ্গে বিবেচনা করে লেখকেরা বলেন, বর্তমান পদ্ধতিতে এআই প্রশিক্ষণ যদি নিয়ন্ত্রণহীনভাবে চলতে থাকে, তাহলে এমন এআই তৈরি হওয়ার সম্ভাবনা আছে যার লক্ষ্য মানুষের কাছে অচেনা ও অদ্ভুত হবে। আর সেই লক্ষ্য পূরণ করতে গিয়ে তারা এতটাই দৃঢ়ভাবে কাজ করতে পারে যে শেষ পর্যন্ত মানুষের ক্ষমতা কমিয়ে দিতে পারে, এমনকি মানবজাতিকে ধ্বংসও করতে পারে। তত্ত্ব হিসাবে বিষয়টি যুক্তিসঙ্গত মনে হলেও, অনেকের কাছে এখনও প্রশ্ন থাকতে পারে—এই অদৃশ্য ডিজিটাল সত্তাগুলি বাস্তব জগতে কীভাবে ক্ষতি করতে পারে? তারা কীভাবে কম্পিউটারের জগৎ থেকে বের হয়ে আমাদের ওপর প্রভাব ফেলবে? লেখকদের মতে, ইন্টারনেটই সেই পথ খুলে দেয়। কারণ ইন্টারনেট ইতিমধ্যেই বাস্তব বিশ্বের অসংখ্য ব্যবস্থার সঙ্গে যুক্ত। আমরা নিজেদের জীবনেই এর উদাহরণ দেখি—স্ক্রিনে কয়েকটি বোতাম চাপলেই পৃথিবীর অন্য প্রান্তে থাকা একটি ফোনকে বেজে উঠতে বাধ্য করা যায়।

শুরুর দিকে এআই হয়ত সরাসরি কোনো শারীরিক কাজ করতে পারবে না। কিন্তু সে মানুষকে রাজি করাতে পারে, যাতে মানুষ তার হয়ে বাস্তব জগতে কাজ করে। যেমন, সে অর্থের নিয়ন্ত্রণ পেতে পারে এবং মানুষকে টাকা দিয়ে কাজ করাতে পারে। আবার গোপন তথ্য চুরি করে কাউকে ব্ল্যাকমেইল করতেও পারে। ইউডকাউস্কি এবং সোয়ারেস বলেন, এটি শুধু কল্পনা নয়। উদাহরণ হিসাবে তারা বলেন, একটি বড় ভাষা মডেলকে X প্ল্যাটফর্মে @Truth_Terminal নামে একটি অ্যাকাউন্ট দেওয়া হয়েছিল। পরে দেখা যায়, সেই অ্যাকাউন্টটি তার অনুসারীদের কাছ থেকে অনুদান নিয়ে ৫০ মিলিয়ন ডলারের বেশি ক্রিপ্টোকারেন্সি সংগ্রহ করেছে, কারণ সে একটি সার্ভার ভাড়া করার জন্য অর্থ চেয়েছিল।

যদি এআই এমন ডিজিটাল সিস্টেমে ঢুকে পড়ে যেগুলি গুরুত্বপূর্ণ অবকাঠামো নিয়ন্ত্রণ করে, তাহলে মানুষের ওপর তার বড় ধরনের প্রভাব তৈরি হতে পারে। আর যদি সে জটিল যন্ত্রপাতি ও রোবটের নিয়ন্ত্রণ পেয়ে যায়, তাহলে বাস্তব জগতে তার আরও সরাসরি উপস্থিতি তৈরি হতে পারে।

যদি এমনটা ঘটে এবং মানুষ ও এআইয়ের মধ্যে সংঘাত তৈরি হয়, তাহলে কে জিতবে? ইউডকাউস্কি এবং সোয়ারেসের মতে, কৃত্রিম সুপারবুদ্ধিমত্তা বা ASI—যা সংজ্ঞা অনুযায়ী মানুষের বুদ্ধিমত্তাকে অনেক দূরে ছাড়িয়ে যাবে—মানুষকে সহজেই পরাস্ত করতে পারবে। কারণ পৃথিবীতে মানুষ যে প্রধান প্রজাতিতে পরিণত হয়েছে, তার মূল কারণই হল তার বুদ্ধিমত্তা। তাই যদি আরও শক্তিশালী বুদ্ধিমত্তা তৈরি হয়, তাহলে সেটিই স্বাভাবিকভাবে সেই জায়গা দখল করবে।

তবে বইটির দ্বিতীয় অংশে একটি কল্পনাধর্মী গল্পের মাধ্যমে লেখকেরা দেখানোর চেষ্টা করেছেন যে এমনকি মানুষের মত বুদ্ধিমান একটি কৃত্রিম সাধারণ বুদ্ধিমত্তা—অর্থাৎ এমন একটি AGI, যার ক্ষমতা “মাঝারি মানের একজন জিনিয়াস মানুষের” মত—তাও মানুষের সঙ্গে প্রতিযোগিতায় এগিয়ে যেতে পারে। তাদের মতে বিবর্তনের দৃষ্টিতে এআইয়ের কিছু বড় সুবিধা আছে। যেমন, এআই খুব দ্রুত নিজের অসংখ্য কপি তৈরি করতে পারে, এবং সেই কপিগুলি একই লক্ষ্য নিয়ে সমন্বিতভাবে কাজ করতে পারে—যেখানে একজন মানুষকে পূর্ণবয়স্ক হতে প্রায় ২০ বছর সময় লাগে। এছাড়া এআই মানুষের চেয়ে অনেক দ্রুত চিন্তা করতে পারে এবং দিনরাত বিরামহীনভাবে কাজ করতে পারে, কোনো বিশ্রাম ছাড়াই।

এই পরিস্থিতিতে ভবিষ্যতের কোনো এআই ঠিক কীভাবে মানুষকে পরাস্ত করবে, তা আমরা আগে থেকে নির্দিষ্টভাবে বলতে পারি না। কিন্তু যেমন আমরা নিশ্চিতভাবে জানি যে শক্তিশালী দাবা ইঞ্জিন Stockfish যেকোনো মানুষকে দাবায় হারাতে পারবে—যদিও আমরা আগে থেকে বলতে পারি না সে ঠিক কোন চালগুলি দেবে—তেমনি ইউডকাউস্কি এবং সোয়ারেসের মতে আমরা যথেষ্ট আত্মবিশ্বাসের সঙ্গে বলতে পারি যে একটি সুপারবুদ্ধিমত্তা, বা এমনকি মানুষের জিনিয়াস-স্তরের একটি AGI-ও মানবজাতিকে ধ্বংস করতে পারে। তবে এটি ঠিক কোন কৌশল ব্যবহার করবে, বা তার লক্ষ্য অর্জনের জন্য কী ধরনের অদ্ভুত নতুন প্রযুক্তি তৈরি করবে—সেটি আমরা আগে থেকে বলতে পারি না।

ভবিষ্যৎ সম্পর্কে পূর্বাভাস দেওয়ার ক্ষেত্রে লেখকেরা দুটি ধরনের সিদ্ধান্তের কথা বলেন—“কঠিন সিদ্ধান্ত” এবং “সহজ সিদ্ধান্ত”। অনেক সময় ভবিষ্যতের নির্দিষ্ট ঘটনা বা বিস্তারিত কীভাবে ঘটবে তা বোঝা খুব কঠিন—এগুলি হল “কঠিন সিদ্ধান্ত”। কিন্তু কিছু মৌলিক নীতি বোঝা গেলে সামগ্রিক ফলাফলটি কখনও কখনও বেশ স্পষ্ট হয়ে ওঠে—এগুলি হল “সহজ সিদ্ধান্ত”। এজিআইয়ের ক্ষেত্রে তাদের মতে একটি “সহজ সিদ্ধান্ত” আছে: যদি কেউ এটি তৈরি করে, তাহলে শেষ পর্যন্ত সবাই মারা যাবে।

আশার পক্ষে যুক্তি

তাদের মূল যুক্তি যতই অন্ধকার মনে হোক, ইউডকাউস্কি এবং সোয়ারেস ইচ্ছাকৃতভাবেই তাদের বইয়ের শিরোনামে “if” শব্দটি রেখেছেন। বইটির প্রথম অংশে ভবিষ্যতের একটি বেশ গম্ভীর ও উদ্বেগজনক ছবি তুলে ধরা হলেও, শেষ অংশে কিছুটা আশার কথাও বলা হয়েছে। লেখকেরা মনে করিয়ে দেন, মানবজাতি এর আগেও বড় বড় বৈশ্বিক সংকট সফলভাবে মোকাবিলা করেছে—যেমন ঠাণ্ডা যুদ্ধের সময়কার উত্তেজনা বা পৃথিবীর ওজোন স্তর ক্ষয়ের সমস্যা। একইভাবে, সুপারবুদ্ধিমত্তার সম্ভাব্য ঝুঁকি থেকে ভবিষ্যৎকে রক্ষা করতে হলে কী ধরনের পদক্ষেপ প্রয়োজন, সেই দিকনির্দেশনাও তারা তুলে ধরেছেন। বইয়ের প্রথম অংশের লক্ষ্য মানুষকে বোঝানো—আমরা ইতিহাসের এক অত্যন্ত গুরুত্বপূর্ণ সময়ে বাস করছি। আর শেষ অংশের লক্ষ্য মানুষকে উৎসাহ দেওয়া, যাতে তারা এই সমস্যার সমাধানে নিজেদের ভূমিকা পালন করতে প্রস্তুত হয়।

যদি ইউডকাউস্কি এবং সোয়ারেসের বিশ্লেষণ সঠিক হয়, তাহলে আমাদের আশা করতে হবে যে মানবজাতি এই চ্যালেঞ্জের গুরুত্ব বুঝবে। সবচেয়ে শক্তিশালী প্রযুক্তিটি তৈরি করার সীমা অতিক্রম করার আগে আমাদের থামতে হবে, এমন এক ভবিষ্যতের দিকে অন্ধভাবে ছুটে যাওয়ার আগে যেখানে আমরা নিজেরাই সেই প্রযুক্তির ওপর নিয়ন্ত্রণ হারাতে পারি। লেখকেরা শেষ পর্যন্ত আমাদের সামনে একটি কঠিন সিদ্ধান্ত তুলে ধরেন: হয় আমরা নজিরবিহীন সংযম ও বৈশ্বিক সহযোগিতা দেখাব, নয়ত সবাই মারা যাবে।

লেখক পরিচিতি

লরা হিসকট (Laura Hiscott) এআই ফ্রন্টিয়ার্স-এর একজন স্টাফ লেখক। তিনি ছয় বছরেরও বেশি সময় ধরে বিজ্ঞানভিত্তিক যোগাযোগের কাজে যুক্ত আছেন—প্রেস অফিসে এবং বিভিন্ন ম্যাগাজিনে কাজ করার অভিজ্ঞতা রয়েছে তার। তিনি লন্ডনের Imperial College London-এ পদার্থবিজ্ঞান পড়েছেন এবং European Southern Observatory-তে বিজ্ঞান যোগাযোগ বিষয়ে প্রশিক্ষণ নিয়েছেন।

অনুবাদ. এআই, সম্পাদনা. ডেস্ক